@leosnackk Написать мне в Telegram

Специалист по парсингу данных

-

Ищем опытного специалиста по парсингу данных для работы на полный рабочий день. Основная задача – сбор и структурирование данных с различных веб-сайтов.

Обязанности:

Разработка и настройка скриптов для автоматического парсинга данных.

Сбор данных с различных веб-сайтов и преобразование их в структурированный формат (JSON, CSV, Excel и т.д.).

Обход капч, систем защиты и других ограничений.

Регулярный мониторинг источников данных для актуализации информации.

Поддержка и доработка существующих парсеров.Условия работы:

Удалённая работа.

Заработная плата $1000 в месяц.

Гибкий график, но с выполнением поставленных задач в срок.

Возможности для профессионального развития и роста.Если вы любите разбираться в сложных задачах, работать с большими объемами данных и готовы расти вместе с нами, будем рады видеть вас в нашей команде!

-

M Moderator moved this topic from Off topic on

M Moderator moved this topic from Off topic on

-

@mikivin said in Специалист по парсингу данных:

а существующие парсеры на чем написаны?

Можно поиграть в угадайку, например, https://scrapy.org, если не нужен браузер.

-

Собирать данные можно с помощью чего угодно, и тем не менее обычно(в моем опыте) используются все таки более привычные инструменты.

Пример:

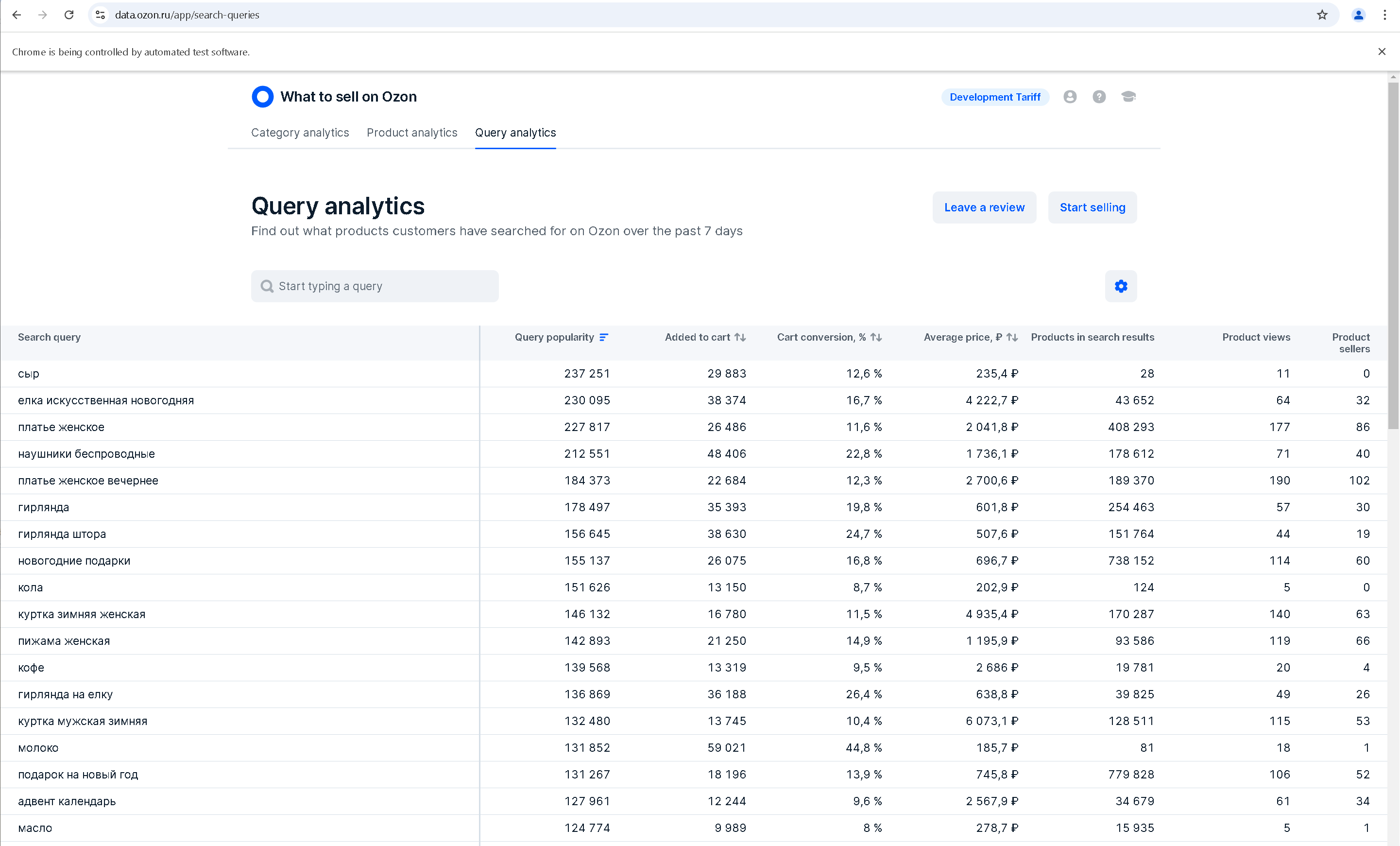

https://github.com/sergerdn/ozon-search-queries-collectorМожно, конечно, написать такое только используя BAS, вот только вопрос - а зачем?

Собранные данные:

[ { "_keyword": "дозатор для жидкого мыла", "_scraped_at": "2024-12-16T09:39:08.157158", "avgCaRub": 1050.92, "avgCountItems": 6592.7656, "ca": 0.2962, "count": 2907, "itemsViews": 60.26694, "query": "сенсорный дозатор для жидкого мыла", "uniqQueriesWCa": 861, "uniqSellers": 35.900585 }, { "_keyword": "дозатор для жидкого мыла", "_scraped_at": "2024-12-16T09:39:08.158146", "avgCaRub": 436.66, "avgCountItems": 21091.857, "ca": 0.3251, "count": 1261, "itemsViews": 43.363205, "query": "жидкое мыло для дозатора", "uniqQueriesWCa": 410, "uniqSellers": 18.18874 } ]