@DreamTeam в данном модуле, отсутствует функция "Удалить текущий элемент".

Элемент можно удалить получив либо его индекс, либо по значению.

@maksimiron13 Использовать модуль json в скрипте с любым действием.

@Ressive said in Модуль для ИИ:

ChatGPT модуль не хочет считывать переменные в промте.

Он вроде как работает только с той инфой, которую руками нужно вбить в промт, как работать с переменными?

Все норм, не работал на gpt-4-32k, на gpt-4 работает, если есть подписка.

Кто то нагружать запросами GPT пробовал ?

Если к примеру 30 потоков за 1 минуту обратятся с разными вопросами на одном api, он дуба не даст ?

Проверил многопоток, такая схема, работает но ставит в некую очередь, и отдает по частям.

Отправил в 1 секунду на 1 api сразу 30 запросов.

3 ответа пришло почти сразу.

И далее каждые 5-6 сек оставшиеся ответы так же пачками по 3 штуки.

Последние не хватило времени, и пришлось по ошибке заново спрашивать. Пока не забанило, если уйдет ключ в бан, буду использовать 3-4 чтоб не нагружать.

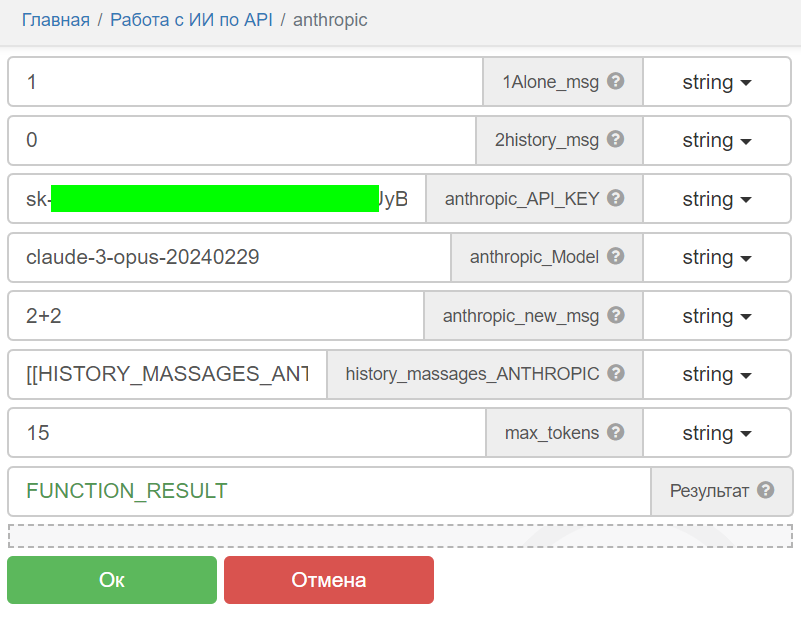

Добавил ИИ от anthropic.

Схема работы такая же как и с gpt. При работе с историей переписки, в случае если ответы больше 15 токенов, уходит на ошибку. Не разобрался почему, может у вас идеи есть по этому поводу.

Инструкцию по работе обновил в первом посте.

Видео по обновлению с Antropic

@moonsoon

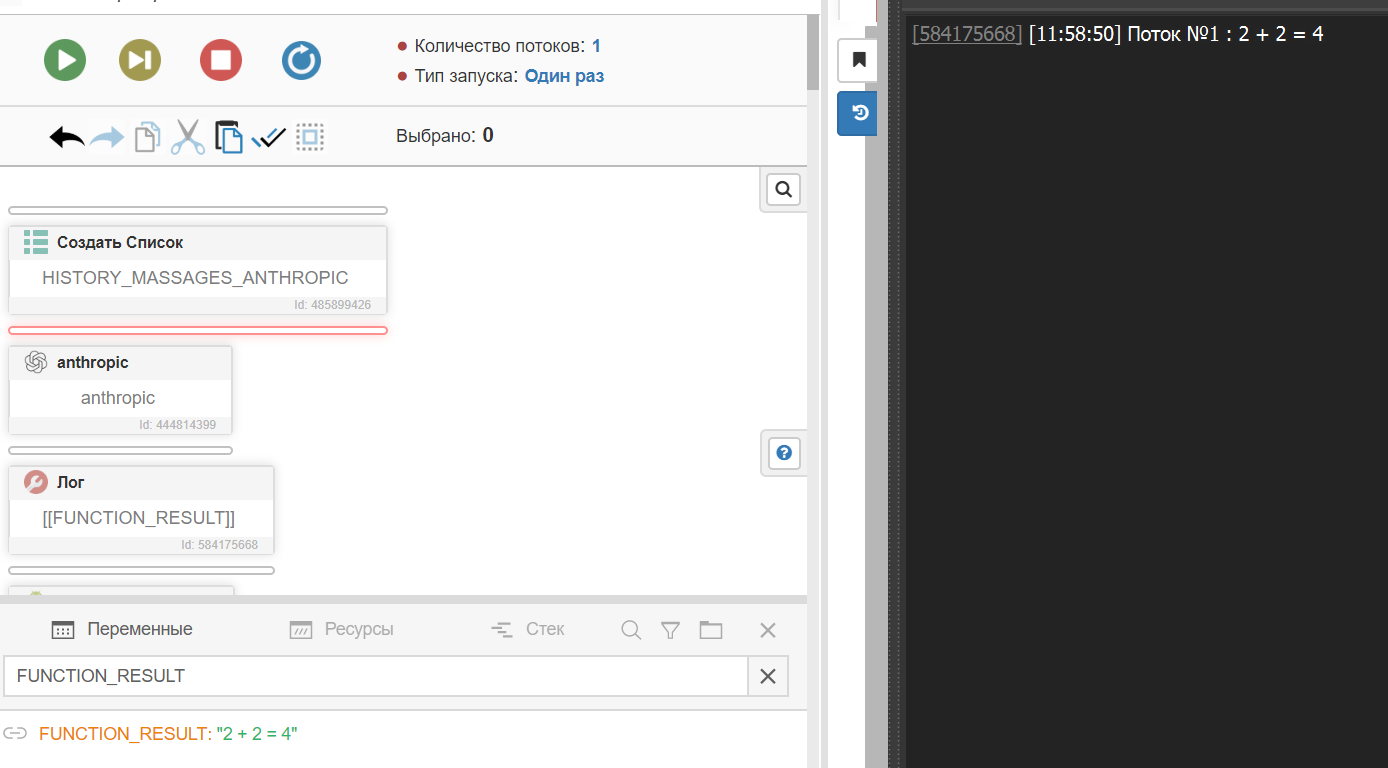

Как бороться с мусором в ответе? Ведь ответ может иметь все возможный вид как захочет AI модель , может ответить :

Например так:

Result 4

или так:

four

или так:

4

или так:

2+2=4

конечно можно заранее все возможные варианты мусора записать и чистить ответ от мусора.

Что я и реализовал в одном моем скрипте, но там получилось сотни вариантов мусорных данных которые нужно удалить из ответа чтоб оставить только то что мне нужно.

Но это костыли которые пришлось делать пока более простого варика нету

@Nikolas said in Модуль для ИИ / Anthropic/ ChatGPT / StableDiffusion / DALLE:

Как бороться с мусором в ответе?

Не сталкивался с этой проблемой, пробуй формулировать в промте что именно ты хочешь получить, но если у тебя история сообщений используется то только условиями вычленять нужную информацию, избавляться от ненужной информации в скрипте.

Url: https://api.openai.com/v1/chat/completions

Status: 502

Proxy-Connection: close

Content-type: text/html; charset=utf-8

CONNECT tunnel failed, response 502

Вот что выдает. Прокси работает, с другими сайтами всё в порядке. А, я понял. Проблема с api ключом. Я когда брал его на сайте через виртуальный номер, мне сообщили, что он не уникальный, но api key тем не менее я смог сгенерировать. Но видимо это какой-то нерабочий api key

а как ты реализовал этот список истории чата для многопоточного режима или даже для однопоточного покругу?

@jostvanburen список который ты указываешь для диалогов локальный для каждого потока. Передаётся вместе с новым сообщением история. 1 запрос = вся история переписки указанная в локальном списке.

@moonsoon я хочу создать подобный чат гпт с другой моделью но когда. У меня сработало так: Я создаю ресурс в начале запуске софта один раз. Потом ресурс в лист записал новые сообщенияв лист и отдаю лист с новыми елементами ресурсу и так по кругу. Тоесть вместо ДБ исп ресурс. Если у тебя более короткий метод скажи пожалуйста