Новая версия 1.3

Убрал зависимость от модуля "Строка"В режиме компиляции не работало, если в проекте не было действий этого модуля.

Классный модуль, у меня все работает - надо просто использовать платный ключ

настроил модуль чтобы чат анализировал название ролика на ютюбе и решал целесообразно ли ботам его смотреть или нет, так же оценивает популярность ролика по просмотрам и дате публикации- в итоге несколько кубиков заменили десятки и экономят кучу времени!

спасибо разработчику- крутой модуль!

Добавил использование локальной ИИ через LM Studio Видео работа с локальной ИИ Обновление версии в шапке.

@moonsoon Привет, подскажи плиз, а какая версия DALL-E от OpenAI используется в кубике?

Вроде у OpenAI самая последняя выпущенная версия DALL·E -> версия DALL·E 3

У тебя в кубике не указана версия DALLE, и когда генеришь картинку через апи твоим кубиков, то получается как будто масляными красками нарисовано, создается впечатление что через твой кубик идет запрос к старой версиии DALL-E от OpenAI

А так в принципе оч удобно и классно работает. Спасибо большое за модуль. Всех благ тебе!

@moonsoon

вобщем путем тестов понял что в модуле даже в версии 1.0 стоит запрос на DALLE явно версию ниже чем их последняя нормальная у них версия dalle3

@moonsoon Плиз добавьте в модуль в кубик для генерации юзая DALEE выбор версии.

Для этого просто PostData нужно указать вот что (по крайней мере в пост запросе так это делается):

"model": "dall-e-3",

Вот результаты моих тестов:

Это еще ничего получился котик на кресле юзая версию из модуля, а например когда про крипту генеришь картинки модулем, то там вообще в стиле Пикассо красками мажет ((

Приведу пример

Промпт White cat

-из модуля результат:

Еще результаты юзая обычный пост запрос к более новой версии чем в модуле (версии DALLE-3):

промпт: Man cryptoking

у меня наблюдается такая проблема, что ИИ выводит смешанный ответ... часть на русском, часть на англ. может даже иероглифы запихать...

Вот пример...

Запрос: кто написал стих, у лукоморья дуб зеленый... ?

Ответ ИИ: Этот стих written by Russian poet Alexander Pushkin.

как сделать, чтобы ответ был только на русском языке?

Локальная модель

Или если пишет на одном языке... то ответы, это что-то с чем-то

Запрос: если 7х7 будет 49, то напиши Да

Ответ ИИ: Нет, это не так. 7х7 = 49, а не 7х7 = 49. Это потому, что 7х7 — это произведение двух чисел, и в этом случае число 7 умножается на себя дважды, поэтому получается 49.

Может это только мне такой вредный ИИ попался... Как найти с ним общий язык?!

@berubah said in Модуль для ИИ / Anthropic/ ChatGPT / StableDiffusion / DALLE / Llama локально:

great module, do you plan to update with deepseek in the module ?

Hi, Deepseek has full support of the OpenAI API. You just need to change the hostname of the API.

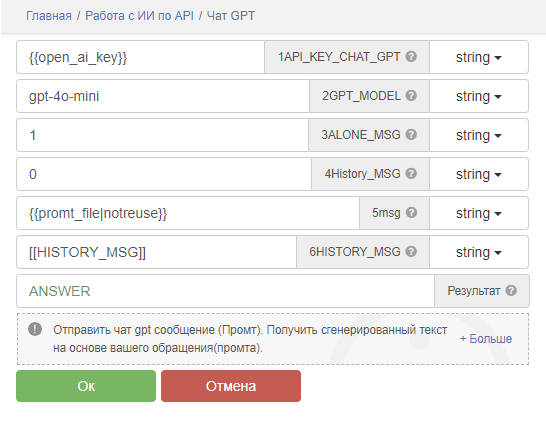

@moonsoon описание оставляет желать лучшего. в версии 1.0 не понятно как слать сообщения без истории. Не понятно, что нужно указать в поля, если не 0. Было бы понятнее, если бы в модуле использовались True/False. И нет упоминаний, что список нужно очищать, если хотите слать без истории. Без списка не работает модуль - 6HISTORY_MSG is empty. Вот мой пример настройки для использования без истории

Привет, в режиме запуска почему то выдает ошибку: Поток завершился с сообщением "ReferenceError: Can't find variable: JPath", в записи все четко

@artempoliansky добавь в скрипт действие из модуля json